Roboter-Autos

Wie Autos das Denken lernen

Künstliche Intelligenz spielt beim autonomen Fahren eine zentrale Rolle: Dem Auto der Zukunft wird sein Wissen antrainiert. Der Uni-Professor Andreas Geiger erforscht am Tübinger Max-Planck-Institut für intelligente Systeme, wie man Autos beibringen kann, ohne Fahrer durch den Straßenverkehr zu kommen.

Selbstfahrende Autos sind längst auf deutschen Straßen angekommen. Nicht nur in den USA oder China lernen die Fahrzeuge, sich im Straßenverkehr zurecht zu finden, seit einigen Jahren werden auch hierzulande sämtliche Streckentypen testweise befahren, Autobahnen, Bundes- und Landstraßen, Stadtgebiet oder Wohnsiedlungen. Teilweise ist spezielle Technik aufgestellt. Kameras oder Sensoren für Wetterdaten sind an Ampeln montiert oder sogenannte Landmarkenschilder aufgebaut, damit die Fahrzeuge ihren exakten Standort selbstständig bestimmen können. Aber bis Computer die Autofahrt komplett übernehmen, ist es noch ein weiter Weg. Denn die Vision vom autonomen Fahren ist schwerer zu verwirklichen als gedacht. Die Technik autonomer Fahrzeuge ist komplex: Videokameras, Ultraschall, Radar- und Laserscanner sowie jede Menge Sensoren. Sie erfassen permanent das Verkehrsgeschehen und tasten alle paar Millisekunden die Umgebung rund um das Auto ab. Im bordeigenen Computer werden alle Informationen der einzelnen Technologiebausteine zu einem Gesamtbild verarbeitet und mit unzähligen dort gespeicherten Szenarien abgeglichen. Aber woher kennt der Computer die Szenarien?

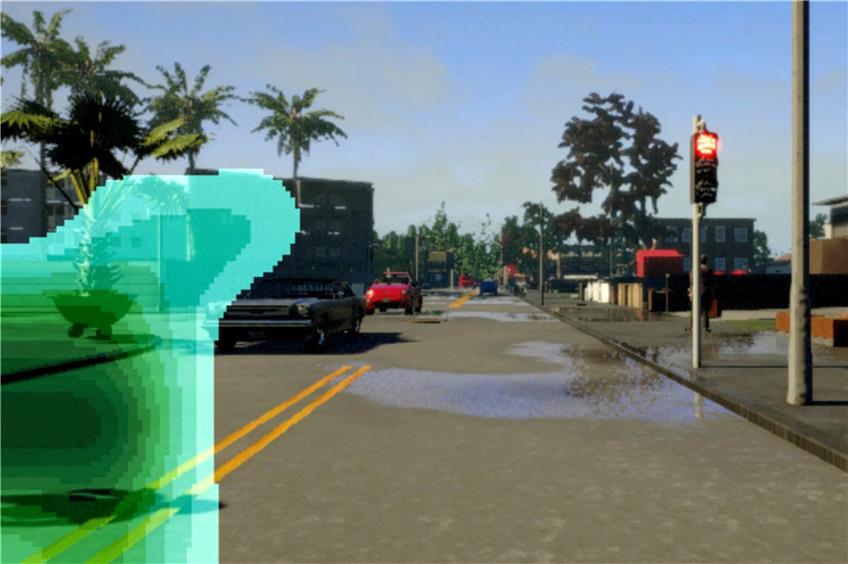

Die Visualisierungen zeigen, welche Bereiche im Bild von dem neuronalen Netzwerk als relevant eingestuft werden.

Grün bedeutet: Keine Gefahr vor dem Fahrzeug. Rot bedeutet: Gefahr vor dem Fahrzeug = bremsen. Bild: MPI

Prof. Andreas Geiger. Bild: © Annette Cardinale

Andreas Geiger entwickelt als Professor der Universität Tübingen am Tübinger Max-Planck-Institut eine solche visuelle Software für Autos. „Maschinelles Lernen ist beim autonomen Fahren viel wichtiger geworden. Man versucht mit viel mehr Datenmengen, viel mehr Rechenleistung und viel größeren Modellen aus echten Daten zu lernen“, sagt Geiger. Es reicht aber nicht, die Systeme mit ausreichenden Daten zu füttern, um sie lernen zu lassen. Die Systeme müssen erst auf die Interpretation der Daten trainiert werden.

Der Mensch könne das intuitiv sehr gut. „Wenn der Mensch fünf Pferde gesehen hat, weiß er auch bei dem sechtsen, dass es ein Pferd ist. Aber für die Maschine ist das noch sehr schwierig“, sagt Geiger. Autos sollen ihre Umgebung besser erkennen können: Fußgänger, Radfahrer oder Skateboardfahrer werden über Sensoren und Kameras wahrgenommen. Das Auto muss sie dann als solche erkennen und die richtigen Schlüsse daraus ziehen.

Genau daran arbeitet Geiger und sein Team: An einer Bilderkennungs-Software, die so gut wie alle Situationen im Straßenverkehr erkennen und einordnen soll und so künftig die Entscheidung fällen kann, in welchen Situationen eine Gefahr für den Fahrer und seine Umgebung besteht. Geiger arbeitet mit Bildern, Videos und Laserdaten. Hochdimensionale Daten, rund 20 Millionen Pixel aus der Bordkamera erreichen den Rechner im Fahrzeug jede Sekunde. „Die Software im Auto muss nicht nur Objekte, sie muss auch die 3-D-Struktur der Welt erkennen, Entfernungen berechnen, Bewegungen deuten“, sagt Geiger. Damit der Rechner das korrekt analysieren kann, entwickelt Geiger komplexe Lösungen und speist sie in den Rechner ein. So lernt der Computer, dass eine bestimmte Pixelkonfiguration einen bestimmten Gegenstand bedeutet.

„Wir arbeiten hier eher im akademischen Bereich“, sagt Geiger. „Deep Learning, autonomes Fahren und Computer Vision sind drei aktuelle Schlüsseltechnologien. Wir arbeiten an der Kreuzung von allen dreien.“

Push aufs Handy

Push aufs Handy